Le français Cartesiam, le californien Edge Impulse et le canadien Motion Gestures ont décidé d’intégrer leurs technologies logicielles respectives de machine learning (apprentissage automatique) dans l’environnent de développement intégré (IDE) MPLAB X de Microchip.... Objectif : simplifier la mise en œuvre d’applications d’intelligence artificielle sur les microcontrôleurs 32 bits à cœur Arm Cortex de la société.

L'intégration des interfaces vers les logiciels et solutions de ces trois partenaires dans l’environnement de conception MPLAB X vise à aider les utilisateurs à travers toutes les phases de leurs projets d’intelligence artificielle et/ou d’apprentissage automatique dans les systèmes embarqués, y compris pour la collecte de données, l'apprentissage des modèles et l'implémentation des inférences.

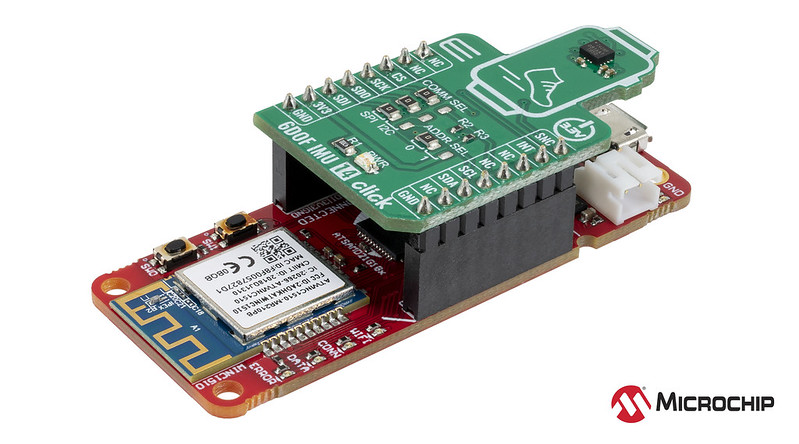

« L'adoption de nos microcontrôleurs 32 bits dans les applications d'IA en périphérie de réseau augmente rapidement, explique Fanie Duvenhage, vice-président du groupe Interface homme-machine et Fonctions tactiles de Microchip. Grâce à ces partenariats et à nos kits d'évaluation tels que l'EV18H79A ou l'EV45Y33A (photo ci-contre), il devient plus aisé de mettre au point des projets de machine learning. »

« L'adoption de nos microcontrôleurs 32 bits dans les applications d'IA en périphérie de réseau augmente rapidement, explique Fanie Duvenhage, vice-président du groupe Interface homme-machine et Fonctions tactiles de Microchip. Grâce à ces partenariats et à nos kits d'évaluation tels que l'EV18H79A ou l'EV45Y33A (photo ci-contre), il devient plus aisé de mettre au point des projets de machine learning. »

Cartesiam, fondé en 2016, est un éditeur de logiciels spécialisé dans les outils de développement d'intelligence artificielle pour microcontrôleurs. NanoEdge AI Studio, l’environnement de développement de la start-up, permet aux développeurs embarqués, sans aucune connaissance préalable de l’IA, de développer rapidement des bibliothèques de machine learning spécialisées pour les microcontrôleurs.

Edge Impulse, de son côté, a mis au point une plate-forme de développement gratuite pour l'apprentissage automatique embarqué, avec un ensemble de jeux de données, des algorithmes DSP et ML, des tests et la génération de code d'inférence efficace pour notamment des applications de détection, audio et de vision.

Motion Gestures, fondé en 2017, fournit, quant à lui, un logiciel embarqué de reconnaissance gestuelle reposant sur l'IA pour différents types de capteurs, y compris le toucher, le mouvement et la vision. La plate-forme de l’entreprise ne nécessite aucune récupération ou programmation de données d'apprentissage et utilise des algorithmes avancés d’apprentissage automatique.

Vous pouvez aussi suivre nos actualités sur la vitrine LinkedIN de L'Embarqué consacrée à l’intelligence artificielle dans l’embarqué : Embedded-IA