La jeune société américaine EnCharge AI créée en 2022, émanation de l’université de Princeton (New Jersey) et qui développe des puces d'IA de calcul analogique en mémoire, une innovation sur le marché, annonce aujourd'hui avoir obtenu un financement de série B de plus de 100 millions de dollars, ce qui porte le financement total de la société à plus de 144 millions de dollars.

Cette levée de fonds a été menée par la société d’investissement Tiger Global, avec les nouveaux investisseurs financiers Maverick Silicon, Capital TEN, SIP Global Partners, Zero Infinity Partners, CTBC VC, Vanderbilt University, Morgan Creek Digital, notamment. Les investisseurs précédents de la société, à savoir RTX Ventures, Anzu Partners, Scout Ventures, AlleyCorp, ACVC et S5V ont aussi participé à cette levée de fonds. Avec en sus le concours de Samsung Ventures, la branche de capital-risque d'entreprise de Samsung, et d’HH-CTBC, un partenariat entre Hon Hai Technology Group (Foxconn) et CTBC VC qui rejoignent l'investisseur historique d’EnCharge AI, VentureTech Alliance.

Ce nouveau financement permettra à EnCharge de commercialiser ses premières solutions d’accélérateur d’IA dès 2026 dans des configurations qui répondent aux besoins des premiers utilisateurs.

Selon EnCharge AI, aujourd’hui, la grande majorité des calculs d’inférence d’IA sont réalisés avec des clusters massifs de puces à forte consommation d’énergie stockées dans des centres de données, ce qui n’est ni écologiquement ni économiquement viable. En tirant parti des améliorations notoires des techologies de calcul capables de déplacer l’inférence d’IA du cloud vers des appareils locaux, EnCharge ouvre la voie à des expériences d’IA nouvelles en dehors du centre de données, tout en améliorant la sécurité, la latence et les coûts.

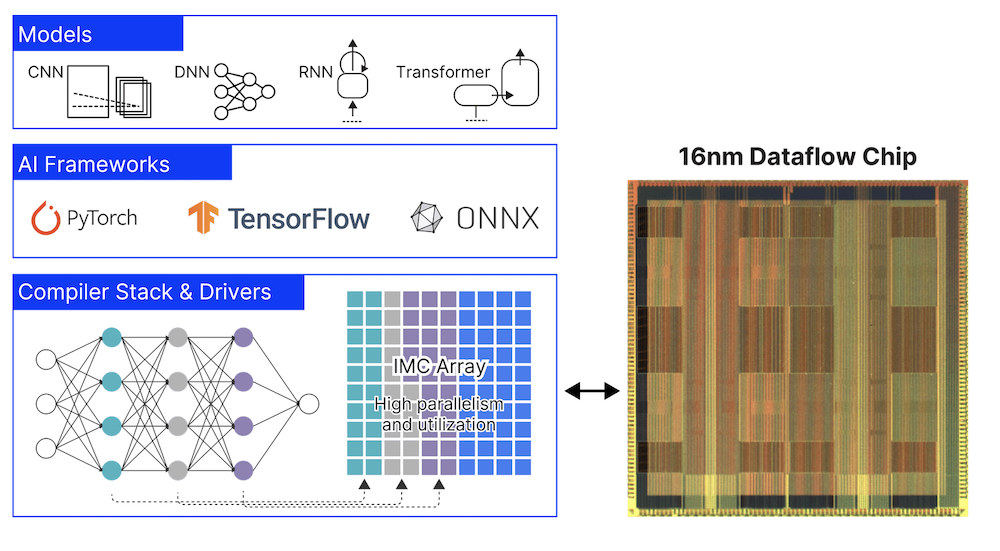

L’architecture de calcul analogique en mémoire résistante au bruit prônée par EnCharge AI a pour ambition de réduire les besoins en énergie liés à l’exécution de charges de travail d’inférence d’IA conventionnelles et génératives. En intégrant un traitement analogique avec une mémoire hautement efficaces, les accélérateurs d’IA d’EnCharge nécessitent, selon la socité, jusqu’à 20 fois moins d’énergie pour exécuter des charges de travail d’IA par rapport aux principales puces d’IA disponibles actuellement sur le marché. Cette architecture est associée à une plateforme d’outils logiciels conçus pour optimiser l’efficacitéet les performances de la technologie d’EnCharge AI.

« La percée en matière d’efficacité de l’architecture analogique en mémoire d’EnCharge AI peut être transformatrice pour les cas d’utilisation de la défense et de l’aérospatiale où les contraintes de taille, de poids et de puissance limitent la manière dont l’IA est déployée aujourd’hui, commente Dan Ateya, président et directeur général de RTX Ventures. La poursuite de notre collaboration avec EnCharge AI contribuera à favoriser les avancées en matière d’IA dans des environnements qui étaient auparavant inaccessibles compte tenu des limites de la technologie actuelle des processeurs. »